Гугл хвастается своими системами машинного обучения, и они действительно хороши

Автор: Иван Новиков Дата: 06.04.2023 23:15

Разработчики Гугла опубликовали красивую и сильную работу, в которой отстаивают одно свое не очень видимое снаружи преимущество перед прочими мощными системами машинного обучения.

Разработчики Гугла опубликовали красивую и сильную работу, в которой отстаивают одно свое не очень видимое снаружи преимущество перед прочими мощными системами машинного обучения.

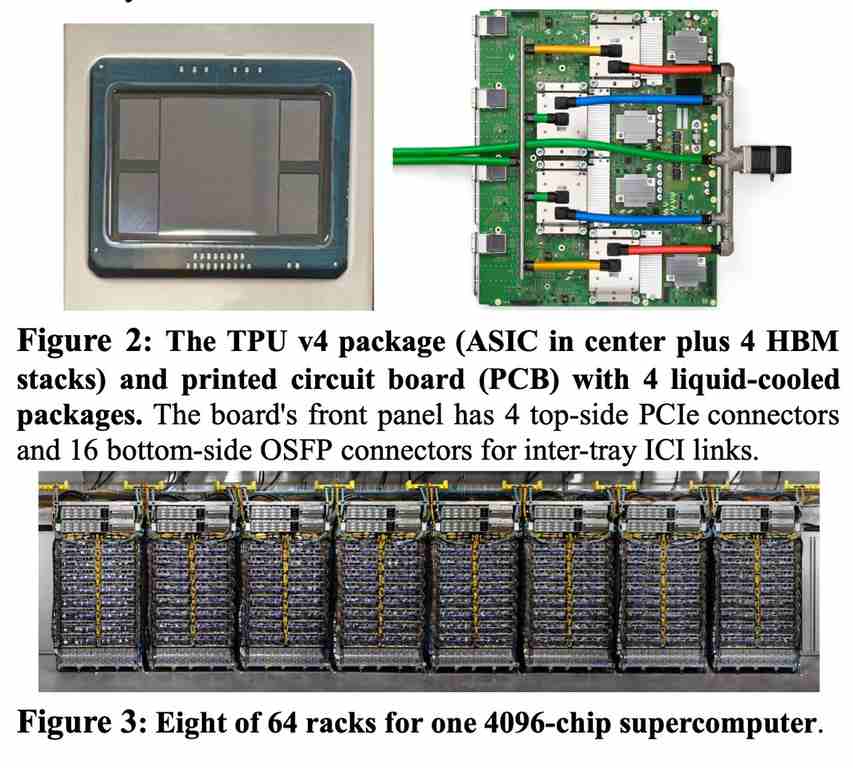

В отличие от остальных, полагающихся на чипы от Nvidia, Гугл создает собственные чипы серии Tensor Processing Unit (TPU). Более 90% ИИ-вычислений в датацентрах компании ведется именно с помощью этих чипов, и вот представлено и описано четвертое их поколение в статье с вкусным названием TPU v4: An Optically Reconfigurable Supercomputer for Machine Learning with Hardware Support for Embeddings.

Свежие суперкомпьютеры Гугла используют по 4096 таких процессоров. Масштабы ресурсов для обучения языковых моделей выглядят так: Google's PaLM model - its largest publicly disclosed language model to date - was trained by splitting it across two of the 4,000-chip supercomputers over 50 days.

Причем утверждается, что система в эксплуатации с 2020 года, и что MidJourney использовала как раз ее.

В общем, серьезная заявка на еще одно соревнование техногигатов: не только в софте, но и в железе.

https://www.reuters.com/technology/google-says-its-ai-supercomputer-is-faster-greener-than-nvidia-2023-04-05/

Оригинал статьи - https://arxiv.org/pdf/2304.01433.pdf

Источник: Автор: Иван Новиков

прочтений: 375 оценки: 0 от 0

© Свидетельство о публикации № 41814

Цена: 1 noo

|

Ваши комментарии

|

Чат

Опросы

Музыка

Треки

НеForМат

Академия

Целит

Юрпомощь

О сервере

О проекте

Юмор

Работа

О нас

Earn&Play

Для контактов

skype:noo.inc

|